High-quality Surface Reconstruction using Gaussian Surfels

本质上这篇文章也是一个 2DGS

SIGGRAPH 2024

本质上这篇文章也是一个 2DGS

SIGGRAPH 2024

SIGGRAPH 2024

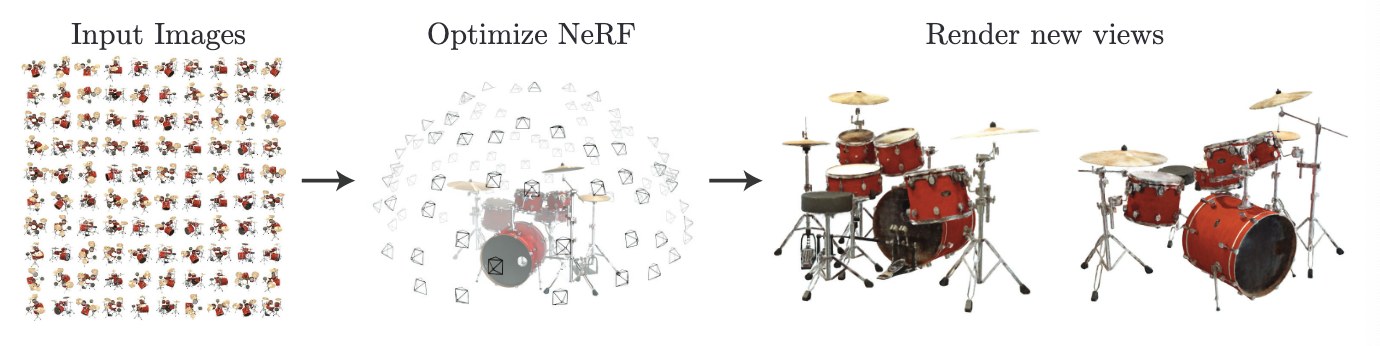

想知道一个模型是干什么的,最简单的方式就是看这个模型的输入输出。先忽略内部细节,NeRF 的输入就是对一个物体从不同角度拍摄的多张图片,输出就是渲染出来的输入集中所没有的新视角下的图片 (如图 1 所展示的那样),简而言之 NeRF 就是合成新视角下的视图的模型。

体渲染技术主要是为了渲染云、烟、雾和火等非刚性物体,这些物体可以看作是一堆聚积在一起的粒子,当光线穿过这些物体时,光中的粒子光子 (Photons) 会与这些物体内部的粒子发生作用,可能被吸收或发生散射等现象,同时这些物体中的粒子本身也可能会发光,这些物体中的粒子被称为参与介质 (Participating Media)。体渲染技术最主流的是在医疗领域,比如 CT 和核磁共振等来获取人体内部的医学数据。

离散化后的体数据可以看成是由 体素 (Vixel) 组成的三维数组,vixel 这个单词是由 volume + pixel 组成,可以理解成是体中的像素,是体的最小单位,每个体素是一个正方体,其中存储的是颜色和密度等信息。

摘要:我们提出了一个方法,通过使用稀疏的输入视图集来优化底层的连续体积场景函数,在复杂场景的新视图合成方面取得了最先进的成果。我们的算法通过一个全连接的深度网络 (非卷积的) 来表示场景,这个网络的输入是一个连续的 5D 坐标 (空间位置 (x, y, z) 和视角 (θ,ϕ)),输出是该空间位置的体积密度和与视角相关的发射辐射强度。我们通过沿着相机光线采样 5D 坐标来合成新的视图,并且使用经典的体积渲染技术将输出的颜色和密度投射到图片上。因为体渲染有天然的可微分性,因此我们对表示的优化只需要唯一的输入,就是一组知道相机姿势的图像集。我们描述了如何高效的优化神经辐射场来渲染逼真的拥有复杂几何和外观的场景新视图,并且展示在神经渲染和视图生成方面超越前人的结果。查看视图合成的结果的最好方式是视频,因此我们建议读者观看我们的补充视频,以进行有说服性的比较。